Dwa spojrzenia na dźwięk przestrzenny. Rozmowa z Blooming Object oraz Maciejem Kuśnierzem

Dźwięk przestrzenny, zwany też immersyjnym, nie jest już dzisiaj nowością. Coraz większe zastosowanie znajduje w kinach, grach i w muzyce. Zanim jednak technologia ta zaczęła odnosić sukcesy komercyjne, przez długie lata była wykorzystywana przez artystów dźwięku. To właśnie twórcze poszukiwania i eksperymenty takich pionierów jak chociażby Xenakis, Stockhausen czy Leitner przyczyniły się do jej rozwoju. Dla zrozumienia tak złożonego zjawiska jak dźwięk przestrzenny bardzo istotne jest spojrzenie na jego praktyczne zastosowanie w sztuce. Studium przypadków w ramach którego przeprowadziłem rozmowy ze specjalistami z dziedziny dźwięku jest próbą zrozumienia różnych perspektyw wykorzystania technologii dźwięku przestrzennego w praktykach artystycznych. Zapytałem twórców, czym w ogóle jest dla nich dźwięk przestrzenny: jak go wykorzystują w swoich projektach, jak jego użycie wpływa proces kreacyjny i jak kształtuje ostateczną formę dzieła. Na łamach Glissanda chcę zprezentować dwa zupełnie różne podejścia. Moi rozmówcy to Maciej Kuśnierz – realizator dźwięku Teatru Animacji, który zrealizował słuchowisko Garnitur Prezydenta z wykorzystaniem nagrywania binauralnego – oraz Blooming Object – duet sound artowy, w którego skład wchodzą Jan Skorupa i Maciej Waleszczyk, twórcy immersyjnej instalacji Ogrody Dźwiękowe. Mam nadzieję, że niniejsze rozmowy rzucą nowe światło na temat dźwięku przestrzennego.

Blooming Object, Ogrody Dźwiękowe

NL: Opowiedzcie proszę o swoim projekcie. W jaki sposób wykorzystywaliście w nim technologię dźwięku przestrzennego?

JS: Nazywamy się Blooming Object i tytułujemy się jako duet sound-artowy, chociaż tak naprawdę projekt jest raczej z domeny audiowizualnej, z naciskiem na dźwięk. Z jednej strony jest to projekt artystyczny obejmujący tworzenie soundscape’ów dźwiękowych, kompozycji, sytuacji instalacyjnych, koncertowych itd. Z drugiej – to też projekt researchowy. Dużo czasu spędzamy nad badaniem narzędzi technologicznych, z którymi pracujemy. Ideowo jest to działanie, w którym operujemy pojęciem muzyki spekulatywnej. Poprzez dźwięk tworzymy kreacje spekulatywne, definiujące alternatywne rzeczywistości, światy, projekcje, fantazje. Urzeczywistniamy je w formie takich immersyjnych doświadczeń. Nie zamykamy się w formie stricte audiowizualnych performansów czy koncertów.

MW: Tak, dźwięk przestrzenny i realizacja koncertowa są jednym aspektem, ale to szeroki projekt, w którym szukamy nowych sposobów wyrażania naszych myśli.

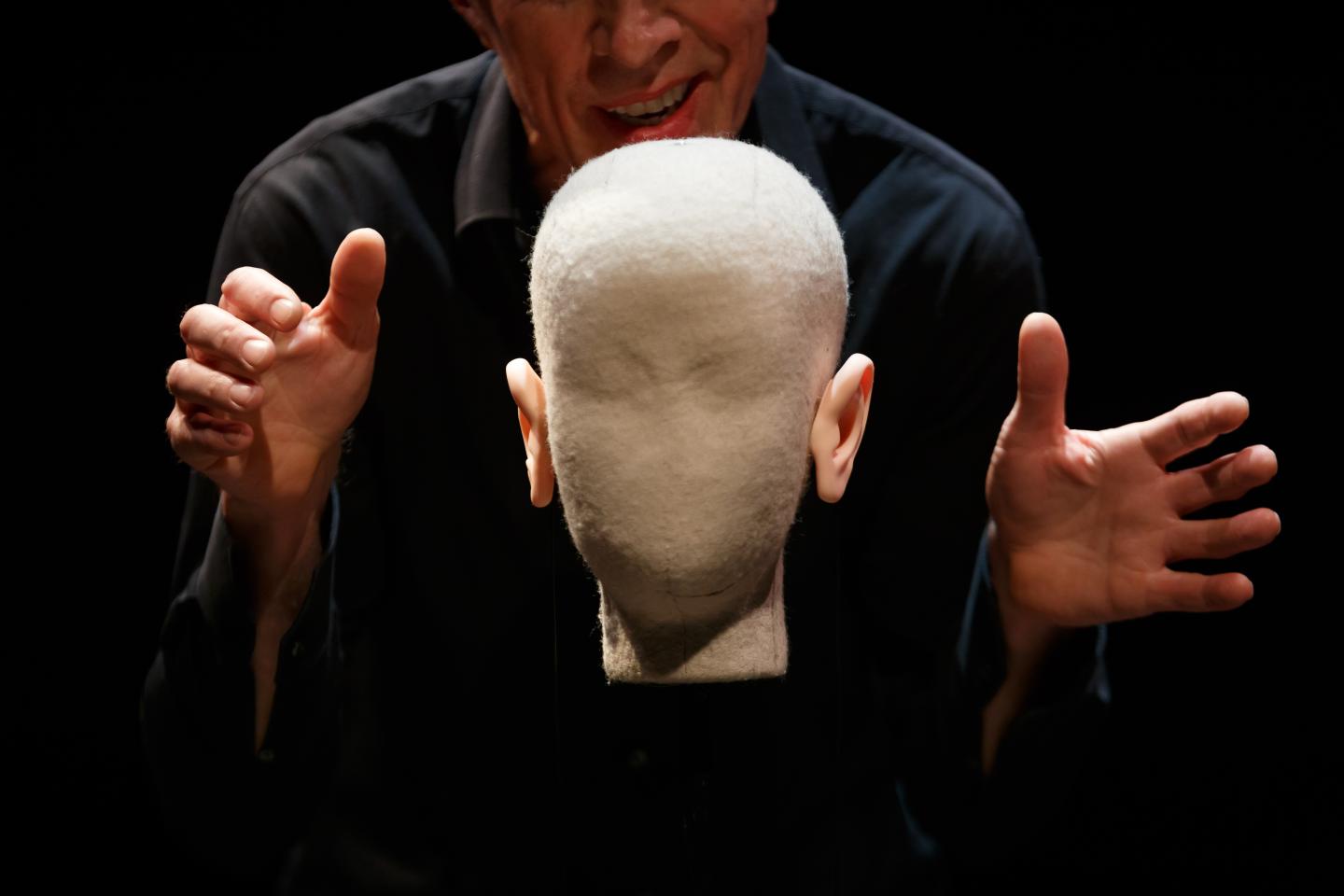

Blooming Object, fot. Paweł Sołoducha.

NL: Chciałbym się skupić na instalacji Ogrody Dźwiękowe, zwłaszcza w kwestii dźwięku przestrzennego – jaką rolę odgrywał on w obrębie dzieła?

MW: Ogrody Dźwiękowe to projekt, którym zaczęliśmy naszą działalność jako Blooming Object. Dotyczy on kreowania konkretnych miejsc i przestrzeni. Każdy z utworów, które gramy na koncercie, jest jednym ogrodem. Jest to kreacja trochę abstrakcyjna i dźwięk przestrzenny służy jako medium, pozwalające usłyszeć to miejsce, zbliżyć się do niego, dokładniej go opisać i pogłębić doświadczenie przebywania w nim.

NL: W dokumentacji do projektu spotkałem się z określeniem Ogrodu Dźwiękowego jako „organicznego ekosystemu dźwiękowego”. Jak się tworzy taki ekosystem? [

JS: Koncepcyjnie ekosystem dźwiękowy jest materią, z którą współpracujemy. Jest to po prostu algorytm komputerowy, który programujemy w środowisku MAX/MSP. Ma on swoją wewnętrzną logikę, głównie opierającą się o zasady prawdopodobieństwa. Posiada autonomiczność i pewną niezależność funkcjonowania, na przykład kreowania jakichś zdarzeń, częstotliwości ich występowania i gęstości. To tworzy strukturę/bazę, w której możemy pracować. Możemy z nią również współpracować i to jest clou naszego projektu. Mamy zatem człon w postaci maszyny. My, kontrolując parametry, definiujemy ekosystem. Nie mamy natomiast kontroli, jaki dźwięk w danym momencie się pojawi. Znamy tylko pewne tendencje i wiemy o różnych zależnościach. A dlaczego „organiczny”? Bo nawiązuje do rzeczywistości – jest w tym przypadek, chaos i niezależność.

MW: To pojęcie służy nam na wielu płaszczyznach, bo „organiczny ekosystem” ma w sobie konotację miejsca, w którym się znajdujemy. Często poruszamy się pośród takich pojęć jak np. „populacje dźwięku” w przestrzeni. Dźwięk wyrasta, przemieszcza się – jest taką „trochę żywą” materią dzięki ruchowi w przestrzeni oraz niezależności algorytmu. My jako twórcy bierzemy tylko udział w ekosystemie, wchodzimy w rolę ogrodników. Dźwięki same kiełkują, wyrastają w przestrzeni. Myślimy więc o autonomiczności jako o wyjściu z centrum zdarzenia i potraktowaniu technologii bardziej na poważnie, jako aktora.

JS: Brian Eno pisał o generatywności dźwięku i porównywał ją do zasadzenia ziarna1. Sadzisz ziarna wybranego gatunku, więc wiesz mniej więcej, co z nich wyrośnie, ale nie przewidzisz, czy będzie dziesięć gałązek, czy cztery. W tym kontekście dźwięk przestrzenny jest kolejnym narzędziem, które pozwala zarówno koncepcyjnie, jak i utylitarnie podkreślić tę wartość. Tworzymy taki „hologram” sytuacji dookólnej i dzięki narzędziom przestrzennym konstruujemy pewną narrację. Ktoś może ją odbierać bardziej jako sytuację performatywną, ktoś inny jako sytuację instalacyjną. Forma performansu nie ma też stricte koncertowej struktury – ludzie przechadzają się, zwiedzają. Dźwięk przestrzenny podkreśla związek z narracją i z doświadczeniem. Jednocześnie jest to dla nas narzędzie, które pozwala podkreślić autonomiczność maszyny – uprzestrzennienie poszczególnych elementów działa w podobny sposób jak ich generowanie – nie kontrolujemy do końca pozycji każdego źródła dźwięku.

NL: Czy poza Brianem Eno mieliście jeszcze inne źródła inspiracji? Konkretna estetyka artystyczna bądź filozoficzna?

MW: Timothy Morton i Mark Fisher. To postacie, których myśli mają wpływ na moją twórczość. W kontekście tego pierwszego myślę o świecie przyszłości i perspektywy człowieka wobec katastrofy ekologicznej, toksyczności, tego, że środowisko się zmienia i nie będzie takie samo. W myśleniu o dalekiej przyszłości, o katastrofach zawarta jest myśl o czasie. W Ogrodach dźwiękowych, w ogóle w muzyce generatywnej, też dużo o nim myślę. Mamy algorytm, który jest w stanie generować w nieskończoność, kreować niezliczone iteracje i zmiany. Jak daleko może sięgnąć? Gdyby miał wystarczająco prądu, to mógłby grać długo po tym, jak człowiek się skończy.

NL: Czyli takie myślenie post-biologiczne, post-humanistyczne?

MW: Krajobraz po człowieku, tak. Nawet gdy gramy, pokazujemy obrazy, czy w ogóle jakoś określamy ten świat [z Ogrodów dźwiękowych – przyp. red.], to wyobrażamy sobie, że nas już tam nie ma.

JS: To jest jeden z filarów ideowych, z którego wynika narracyjność i historia projektu. Inspirują nas też zjawiska muzyki generatywnej same w sobie, ich technologia i workflow. Nie robimy muzyki w Digital Audio Workstation, tylko wychodzimy z pozycji konstruktu MAX/MSP, który to wszystko w jakiś sposób inaczej definiuje. Z bardziej estetycznych aspektów obydwaj mamy skojarzenia z mikropolifonicznymi zdarzeniami muzycznymi.

NL: Teraz już nie tylko człowiek kontroluje maszynę, ale i sama technologia nabywa sprawczości?

MW: Tak, czasem zastanawiamy się, jak tę myśl dodatkowo uwypuklić. Czy my powinniśmy być w centrum? Jak powinny być ułożone głośniki, żeby potencjalnie nas od niego odsunąć?

NL: Jak specyfika pracy z systemami wielogłośnikowymi wpływa na proces twórczy i performatywny?

JS: Przyrównałbym to do harmonii albo do rytmu w muzyce. Na przykład w stereo, w kontekście przestrzeni, linearność ma największe znaczenie. Kiedy masz wielokanałowość i dźwięk otacza cię ze wszystkich stron, to myślisz bardziej momentowo, doświadczeniowo. Mamy dwa komputery, które odpowiadają za generowanie ścieżek dźwiękowych: jeden odpala dźwięki punktowe, drugi – brzmienia dłuższe, dronowe. One razem tworzą „ekosystem”. Trzeci komputer ma za zadanie całość uprzestrzennić. Każdy z dźwięków jest podłączony do wirtualnego źródła, które porusza się w przestrzeni i ma swoją autonomię. Rozplanowanie, jak pogrupować i ustawić dźwięki, było ogromną pracą. Do tego jeszcze gramy przestrzenią w trakcie pokazów. Na przykład w pewnych momentach przybliżamy dźwięki lub oddalamy je, nadajemy im trochę więcej lub trochę mniej pogłosu, skracamy pewne częstotliwości itd. Feedback tych wszystkich elementów między sobą pozwala na wytworzenie zupełnie innej jakości, pogłębienie myśli, które próbujemy zawierać. Otwiera też nowe możliwości eksploracji dźwięku, już nie tyle w kontekście samej kompozycji, ale zjawiska dźwięku samego w sobie.

Blooming Object, fot. Olga Ormańczyk

NL: Jak ważne jest dla was, żeby odbiorca zrozumiał te myśli i narracyjność wewnątrz Ogrodów? Czy widzicie w nich potencjał wielu interpretacji?

MW: Dla mnie jest ważne, żeby odbiorca zrozumiał przynajmniej część. To też jest element pracy i decyzyjności – na ile odsłaniamy nasze myśli? Wydaje mi się, że idea czasu, zwłaszcza przy muzyce generatywnej, jest dość uniwersalna. Na jego odbiór wpływa także to, w jaki sposób budujemy formę, jak brzmi i przebiega koncert, jaki jest poziom abstrakcyjności narracji.

JS: Warstwa wizualna również pomaga w zbliżeniu do idei bycia w innej przestrzeni, w innym momencie, w innej rzeczywistości. Obraz był tworzony generatywnie, w perspektywie z lotu ptaka. Z jednej strony zawarta jest w nim koncepcja „wejrzenia w studnię”, zaglądania do innej rzeczywistości. Lot ptaka z drugiej strony może też przywodzić na myśl sondę z przyszłości, która eksploruje nieznany teren. W warstwie wizualnej raczej nie ma form, które przypominają życie, ale jednak coś tam się rusza. Poza tym zależało nam również na jakiejś formie partycypacji, demokratyzacji słuchania. Wybrane przez nas perspektyw [obrazu i dźwięku – przyp. red.] dają odbiorcy poczucie uczestnictwa w eksploracji, włączenia do ekosystemu. W jednej z instalacji zdecydowaliśmy się na rozmieszczenie głośników w chaotyczny sposób, czyli ominęliśmy ambisoniczną idee sweetspota – odsłuch stał się wyjątkowy i równie wartościowy, nieważne w którym miejscu znajdował się odbiorca. Ja widzę ogromną wartość we wspólnym słuchaniu muzyki czy dźwięku. Wielogłośnikowa przestrzeń jest w tym kontekście dość szczególna – można w niej pobyć samemu lub z kimś. W systemie przestrzennym fajne jest też to, że można osiągnąć wrażenie bardzo wysokiej głośności przy niższych natężeniach. Takie doświadczenie znacznie mniej drażni słuch. Energia sumarycznie jest dość duża, ale nie aż tak, jak z jednego liniowego źródła.

NL: Często w projektach audiowizualnych obraz ma główną rolę, jednak u was obie płaszczyzny zdają się równorzędne.

JS: Z naszej pozycji dźwięk jest ważniejszy, ale z pozycji odbiorcy myślę, że obraz jest tak samo istotny. Momentami może nawet bardziej.

NL: Poza obrazem na immersję zdecydowanie wpływa dźwięk przestrzenny. Czym jest ona w kontekście Ogrodów dźwiękowych?

JS: Z mojej perspektywy immersja jest środkiem, który pogłębia doświadczenie. Może po prostu na zasadzie angażowania wielu zmysłów. Myśleliśmy też o rozszerzeniu projektu o zapach oraz o umieszczeniu w przestrzeni instalacji głośników–obiektów, które można by było dotknąć. Immersyjność jest więc dla nas ważna, na razie osiągnęliśmy ją na poziomie dwóch mediów i dwóch zmysłów. Ostatnio spróbowaliśmy VR, to jest kolejny poziom.

NL: Sądzicie, że wielokanałowość może wpływać na stany psychiczne czy psychofizyczne? Tworząc, myślicie o jakichś emocjach, które chcielibyście wywołać u odbiorcy?

MW: Myślimy o abstrakcyjnym czasie, przyszłości, generatywności… Może to jest stan zawieszenia, który potencjalnie można odczuć. Ale w kwestii emocji, to powiedziałbym generalnie, że raczej szukamy ambiwalencji. Staramy się traktować treść obiektywnie. Tworzymy konkretną sytuację, ale w żaden sposób intencyjnie jej nie komentujemy. Nie nadajemy jej negatywnych lub pozytywnych konotacji. Raczej chcemy doświadczać; zobaczyć, co poczujemy. We mnie wytwarza to spokój bycia w kreowanej przestrzeni. Nie szukamy jakichś bardzo radykalnych sensorycznych doświadczeń. Czasami może zakrawamy o trochę mocniejsze sugestie, ale generalnie takie „po prostu bycie” i spokój są centralnym elementem.

JS: Emocjonalność oczywiście mimowolnie się pojawia, chociażby ze względu na harmonię. Ale to jest raczej narzędzie, jeden z elementów systemu, niekoniecznie intencyjny i celowy. Wynika zwyczajnie z naszej, ludzkiej, obecności, ale nie jest on w żaden sposób przez nas przemyślany czy zaplanowany. Kiedy robiliśmy pejzaże dźwiękowe Ogrodów, to nie myśleliśmy na początku o kolejności. Wytworzyliśmy ich kilka i jak wypracowała nam się struktura to zaczęliśmy pracować z detalami. Dopiero na końcu, już tak kuratorsko, ułożyliśmy je ze sobą i nadaliśmy im tytuły. Na przykład ostatni z Ogrodów nazywa się See you later, maybe never. Jego struktura składa się z dźwięków, które przez cały czas oscylują, fluktuują, oddalają się i przybliżają. Semiotycznie mogłoby to być odczytane jako dramatyczna sytuacja pożegnania. Samo pojawianie się dźwięków i ich oddalanie, rozsrastanie i dekonstrukcja pokazują, że stoi za tym jakaś intencja, ale z naszej strony to była kwestia czysto kreacyjna.

NL: Mówiliście o harmonii, o hałasie. Jak opisalibyście warstwę dźwiękową Ogrodów?

JS: Nazwałbym ją raczej zdarzeniem dźwiękowym niż kompozycją muzyczną. Ogólnie to, co robimy, określamy sztuką dźwięku.

MW: Myśle, że nie ma dużego znaczenia dla nas, co jest czym. Skupiamy się raczej na poszukiwaniu, gdzie byśmy chcieli pójść.

Wiecej informacji o Ogrodach Dźwiękowych można znaleźć na oficjalnej stronie projektu https://bloomingobject.eu/

Maciej Kuśnierz, Garnitur Prezydenta

NL: Jak powstało słuchowisko Garnitur prezydenta?

MK: Garnitur Prezydenta nagraliśmy w technologii binauralnej. Wcześniej zrealizowaliśmy dwa spektakle w poznańskim Teatrze Animacji, które też wykorzystywały mikrofon binauralny. Do pierwszego z nich osobiście zbudowałem model głowy – kupiłem parę mikrofonów DPA 4060, odpływy, odlewy uszu z silikonu imitującego skórę… Jako ciekawostkę mogę powiedzieć, że były sprzedawane jako zestaw do ćwiczenia akupunktury. Zrobiłem w nich małe otwory, do których mieścił się mikrofon. Uszy zostały potem przyczepione do obszytego grubym materiałem styropianowego modelu głowy. Wtedy nie było jeszcze takich modeli mikrofonów, które można by sobie po prostu założyć na uszy. W spektaklach dźwięk z mikrofonu binauralnego trafiał do słuchawek bezprzewodowych, które mieli wszyscy widzowie. Publiczność dostawała także opaskę na oczy, więc nie oglądała spektaklu, tylko go słuchała. Powstały dwa takie projekty – pierwszy to Nic dzika mrówka, Adam i Ewa. Ponieważ taka forma bardzo się spodobała zarówno widzom, jak i aktorom, to powstał drugi spektakl – Halo Kosmos. Obydwa były grane na żywo, jeszcze przed pandemią. W trakcie pandemii stwierdziliśmy, że fajnie byłoby taki spektakl nagrać. Tak powstał Garnitur Prezydenta. Reżyser słuchowiska, Artur Romański, od początku chciał, żeby zrealizować go w technologii binauralnej.

Nic, dzika mrówka, Adam i Ewa, Teatr Animacji, fot. Piotr Bedliński

NL: W jaki sposób pracowałeś z technologią dźwięku przestrzennego?

MK: Muzykę do Garnituru Prezydenta komponował Tomek Lewandowski i musieliśmy razem pomyśleć, czy będziemy ją chcieli wrzucać w świat binauralny i jak to zrobić. Do stworzenia miksu binauralnego muzyki wykorzystaliśmy program Spat Revolution. Nagraliśmy też głosy lektorskie, wrzuciliśmy do Spata i przekształciliśmy na binauralny sygnał. Niemniej około 95% całego materiału do słuchowiska było po prostu nagrane na mikrofon binauralny. Cała przygoda z nagrywaniem wyglądała trochę jak ustalanie planu zdjęciowego. Musieliśmy wymyśleć, w jakiej przestrzeni dźwiękowej widzimy poszczególne sceny i potem odpowiednio ustawić aktorów. Na przykład niektóre sceny nagrywaliśmy tak, jakby działy się one na żywo. Jeżeli była scena np. w kuchni, to chcieliśmy, żeby pojawiły się dźwięki ambientu – szum lodówki czy dźwięk gotującej się wody w czajniku. To była dosyć trudna rola reżyserska, żeby później wyrzucić niektóre elementy dźwiękowe, które za bardzo wchodziły na głosy aktorów. Chcieliśmy przede wszystkim, żeby słuchacz miał cały czas wrażenie obserwowania danej sytuacji. Kiedy skupiamy na czymś swoją uwagę, to zazwyczaj też obracamy głowę w tym kierunku. To jest bardzo ważne w przypadku nagrań binauralnych i znacząco zmienia panoramę wszystkich dźwięków. Dlatego imitowanie ruchów głowy to też była część mojej pracy. Chciałem uniknąć sztuczności, która mogłaby się pojawić, gdybym postawił mikrofon sztywno na statywie – kiedy aktor chodzi po całym pomieszczeniu, to duża część jego tekstu mogłaby padać w takiej sytuacji z jakiegoś dziwacznego kąta.

NL: Czyli rozumiem, że w jakiś sposób imitowałeś ruch modelu głowy, żeby była ona ustawiona w kierunku źródła dźwięku?

MK: Tak. Starałem się też, żeby ruchy były płynne i naturalne. Na przykład, kiedy trzeba było się obrócić o 180 stopni, to nie obracałem samej głowy o 180 stopni, tylko obracałem się wraz z całym statywem, żeby było wrażenie przebywania w danej przestrzeni. Często z nagraniami binauralnymi jest taki efekt wow – niesamowite wrażenie, jakby się tam naprawdę było. Niestety w momencie, kiedy spektakl trwa około godziny, to staje się to bardzo nienaturalne i zaczyna męczyć, a nie wzbogacać wrażenia. Rozwiązaniem była praca reżyserska – żeby jednak większość dialogów działa się mniej więcej przed tą głową, a nie gdzieś po bokach. Oczywiście, kiedy chcieliśmy osiągnąć wyobrażenie przestrzeni, to aktorzy odchodzili od mikrofonu, zmieniali pozycję. Było nawet tak, że aktorka grająca mrówkę cały spektakl była na kolanach, więc dźwięk dochodził poniżej głosu reszty aktorów. Chociaż binaural średnio sobie radzi z wertykalnością, to słychać było, że jest ona gdzie indziej i że jest mniejsza.

Nic, dzika mrówka, Adam i Ewa, Teatr Animacji, fot. Piotr Bedliński

NL: Czyli rozumiem, że ważnym aspektem było oddanie wrażenia, jak gdyby słuchacz „obserwował” scenę teatralną?

MK: Tak, można było znaleźć się bliżej akcji. Większość nagrań robiłem z odległości około metra. Oczywiście, niektóre sceny miały głębszy plan – coś działo się blisko, ale akcja toczyła się też dalej w głąb sceny. W zależności od tego, na czym miałem w danej chwili skupiać uwagę słuchacza, dostosowywałem sposób nagrywania. Były sceny, gdzie po prostu kursowałem między dwoma planami.

NL: A jak było w przypadku nagrywania instrumentów muzycznych i zespołu?

MK: Tu niestety nie było takich możliwości. Muzycy byli rozstrzeleni po całej Polsce, nigdy tak naprawdę nie spotkali się w jednym miejscu. Dlatego też wykorzystaliśmy program Spat, w którym zrobiłem miks instrumentów. Bębny i klarnet były nagrane klasycznie jako żywe instrumenty, w niektórych utworach dodatkowo dźwięki bębnów i piano nagraliśmy za pomocą pluginów VST. Gitara basowa była nagrana liniowo, a miks całego słuchowiska był zrobiony w Abletonie. Spat był tutaj swego rodzaju send & return do Abletona, tzn. można go było zapiąć na dowolnym kanale albo na grupie kanałów jako wtyczkę, przesłać sygnał do Spata i wybrać rodzaj miksu. W moim przypadku był to binaural. Spat to program do miksu obiektowego, czyli ustalamy sobie przestrzeń, w której znajdują się obiekty dźwiękowe i możemy je dowolnie ustawiać w pozycji x, y i z, a także wybrać, czy dane źródło dźwięku jest obrócone w kierunku odbiorcy, czy tyłem do niego. Można też ustawić, jak szeroko brzmi dane źródło dźwięku – czy to jest mały, czy większy punkt.

NL: Czy dźwięki ambientu i otoczenia też nagrywaliście za pomocą mikrofonu binauralnego? Jaką rolę odgrywała tutaj przestrzenność dźwięku?

MK: W większości sytuacji staraliśmy po prostu nagrywać dane dialogi w miejscu, gdzie pożądany ambient już był, dlatego że nawet korzystając z programów do miksu obiektowego nie udałoby mi się uzyskać aż takiej głębi, jak w nagraniu surowym. Próbowałem miksować nagrany ambient, dodać do tego drugie nagranie binauralne i niestety całość dużo traciła. Dlatego nagrywaliśmy aktorów w różnych miejscach, żeby mieć już tło dźwiękowe razem z dialogiem, zamiast potem bawić się w postprodukcję. Prawda jest też taka, że praktycznie każda postprodukcja nagrania binauralnego powoduje zmniejszenie jego rozdzielczości. Im mniej się edytuje, tym lepiej dla wrażenia przestrzeni.

NL: Czyli jak słychać było dźwięki ulicy, to znaczy, że właśnie tam nagrywaliście daną scenę?

Maciej: Dokładnie. Według mnie to było ekstra podejście dla efektu końcowego, choć trudniejsze do zrobienia w danej chwili. Oczywiście też się zdarzało, że nagranie scen na ulicy trzeba było powtarzać 15 razy, ale sam efekt końcowy był tego wart. W słuchowisku jest taki fragment, gdzie orzeł rozmawia z gołębiami. I wydaje się, że siedzą gdzieś wysoko. Weszliśmy na jeden z najwyższych balkonów w CK Zamek i tam nagraliśmy całą scenę. I znowu, wertykalności nie słychać aż tak bardzo, żeby dźwięk miasta dobiegał ewidentnie z dołu, ale brzmi on inaczej, niż gdybyśmy nagrywali z poziomu ulicy. W ten sposób jej ambient jest jednak bardziej rozmyty, pozostaje gdzieś tam w tle.

NL: Myślisz, że takie podejście wpływa na immersję?

MK: Dźwięk binauralny, ponieważ jest związany ze słuchawkami, ma taką dodatkową intymność. Jesteśmy odcięci od dźwięków z zewnątrz i wchodzimy w świat nagrania. To dla mnie zawsze było niesamowite. Lubię wracać do różnych nagrań binauralnych. W momencie, kiedy zamykam oczy, to już jestem w innym świecie. Oczywiście dużo zależy również od budowy mikrofonu, uszu, kształtu głowy i od wielu innych czynników, więc nie wszyscy ludzie słyszą to samo nagranie w identyczny sposób. Niestety nie da się z tym nic zrobić. Niemniej nie spotkałem osoby, która nie odczuwałaby tej immersji w ogóle.

NL: Czy to, że słuchowisko to przede wszystkim opowieść i gra aktorska wpływa w jakiś sposób na sposób realizacji dźwięku?

MK: W pracy w teatrze zawsze jest dźwięk i obraz (z wyjątkiem tych dwóch binauralnych spektakli, gdzie nie było żadnej scenografii), które muszą ze sobą współgrać. Jako realizator dźwięku jestem takim pośrednikiem pomiędzy reżyserem, kompozytorem i odbiorcą. Wszystko, co się dzieje na spektaklach teatralnych i podczas koncertów przechodzi przez moje ręce. To jest praca, która wymaga zrozumienia, co reżyser i kompozytor chcą osiągnąć. Przedstawiają mi pomysł, opowiadają o pożądanym efekcie końcowym czy o tym, jakie chcą zastosować efekty w konkretnym momencie i ja, jako realizator dźwięku, mogę im zaproponować rozwiązania, wymyślić koncepcje i sprawdzić, czy da się je zrealizować. I to niestety często jest kompromis. Kiedy pracujemy z kompozytorem, to zdarza się, że proponujemy swoje efekty dźwiękowe, żeby zaoszczędzić czas. Ale zazwyczaj to są naprawdę drobne rzeczy, bo przede wszystkim musimy pilnować tempa spektaklu. Oczywiście, są odpowiednie cues, kiedy dana muzyka czy efekt powinny wejść. To naprawdę ma spore znaczenie, dlatego że sekunda-dwie na scenie to dla widza jest jak pół godziny w odbiorze. Musisz wiedzieć, kiedy co powinno wejść i na jakim poziomie, bo czasami dźwięki powinny być zupełnie w tle, ledwo słyszalne, budować tylko jakąś atmosferę. Poziomy poszczególnych utworów i efektów są ustalane w trakcie prób i to znowu jest praca z kompozytorem; czy ten utwór ma od razu na wejściu być bardzo głośno, a potem się wyciszyć? Czy raczej ma się delikatnie pojawić i być po prostu ledwo słyszalnym ambientem? Czy dany efekt ma być wyprowadzony na głośniki przestrzenne, czy dobiegać z jednego kierunku? Zdarza nam się, że w ogóle odtwarzamy jakieś dźwięki tylko z monitorów na scenie, żeby oddać jej głębię. Wśród techników dźwięku jest takie powiedzenie, że „jeżeli nikt nic nie mówi, to znaczy, że jest dobrze”.

NL: Czy przy Garniturze prezydenta to również była wspólna praca kompozytora i realizatora dźwięku?

MW: Bywają kompozytorzy, którzy nie są szczególnie skupieni na technologii i możemy im podpowiadać różne rzeczy. Czasami zdarza się, że na próbie nie ma kompozytora w ogóle, a pojawiają się uwagi od reżysera. Wtedy wiadomo, kompozytora się trochę pomija. Ale ogólnie ma on dużo większą rolę i dużo trudniejsze zadanie niż realizator dźwięku. My nie jesteśmy w stanie naprawić złej muzyki, nie możemy samą technologią zmienić kompletnie nastroju, który „dostajemy” od kompozytora. Mamy możliwość wykonania jedynie delikatnych ruchów. Kompozytorzy, którzy piszą dużo muzyki do teatru, potrafią idealnie dopasować ją do sceny. W Garniturze Prezydenta jest przecież utwór „pod utwór” grany na pianinie przez jednego z bohaterów. Dźwięki pianina idą w górę wraz z głosem aktora, zatrzymują się razem z jego zatrzymaniami, idą w dół razem z nim… To jest niesamowite, jak to działa potem na żywo. Aktorzy też zazwyczaj pilnują, żeby wszystko się zgadzało muzycznie z akcją na scenie i z dialogami. To też buduje immersję – muzyka wtedy jest złączona ze wszystkim, co się dzieje i podbija narrację oraz atmosferę.

NL: To jest ciekawy wątek, zderzenie potencjału narratywistycznego i immersyjnego…

MK: Tak. Według mnie w teatrze i w słuchowisku jest pewna hierarchia. Muzyka nie jest równorzędna ze scenariuszem. Scenariusz bez muzyki się obroni, ale muzyce bez niego czegoś brakuje. Trzeba sobie często o tym przypominać. Wiadomo, kompozytor chce, żeby muzyka była głośniej – jest z nią zżyty i pragnie, żeby zabrzmiała jak najlepiej. A potem przychodzi reżyser i nie słyszy, co mówią aktorzy. Historia jest głównym elementem, który chcesz zaprezentować ludziom. Cała reszta ma tylko jej pomóc

Teksty autoryzowane.

Brian Eno, A Year with Swollen Appendices: Brian Eno’s Diary, London 2020, s. 148. ↩